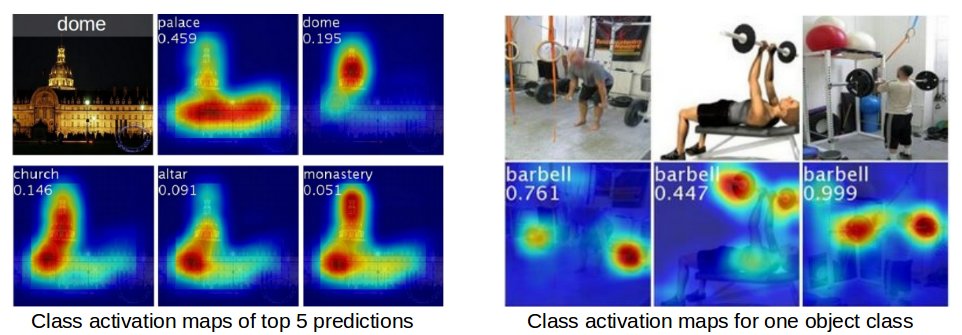

L’attenzione è una delle idee più importanti nella comunità del Deep Learning. Anche se questo meccanismo è ora utilizzato in vari problemi come i sottotitoli di immagini e altri, è stato originariamente progettato nel contesto della traduzione automatica neurale utilizzando modelli Seq2Seq. Modello Seq2Seq Il modello seq2seq è normalmente composto da un’architettura encoder-decoder, in...

Iscriviti alla newsletter

Se vuoi ricevere le nostre news sul mondo tecnologico, sottoscrivi alla nostra newsletter. Zero spam.

House of Codes – Malta

4, Triq L-Isqof Pace,

MLH 1067, Mellieha, Malta

House of Codes – Italia

Via Lazio 63 B/4

65015 Montesilvano (PE), Italia

Iscriviti alla newsletter

Se vuoi ricevere le nostre news sul mondo tecnologico, sottoscrivi alla nostra newsletter. Zero spam.

House of Codes – Malta

4, Triq L-Isqof Pace,

MLH 1067, Mellieha, Malta

House of Codes – Italia

Via Lazio 63 B/4

65015 Montesilvano (PE), Italia

Copyright by House of Codes. Tutti i diritti riservati.